喂饭机器人视觉定位及识别方法研究毕业论文

2020-02-13 22:03:48

摘 要

喂饭机器人的出现是根据实际的需求产生的,在我们的现实生活中,有许多老年人或病人的行动不方便,需要一段时间或者大部分时间躺在床上,这就需要专业的护理人员进行护理,而喂饭机器人则是替代喂饭的工具,因此它的实用性较强,在未来也有较大的市场空间。本论文将针对喂饭机器人的视觉定位和识别问题进行研究,具体的工作包括:通过对喂饭机器人视觉系统的分析,结合机器视觉的理论分析喂饭机器人的视觉系统结构。在实际的护理过程中,喂饭机器人的视觉系统主要需要完成目标检测和双目测距两个内容。目标检测主要目的是为了获取人嘴部的位置,并依据该位置,结合双目测距,获得嘴部区域的坐标。通过对目标检测和双目测距原理的分析,了解进行算法设计需要的数据和硬件准备,并获得了算法的具体结构,我们依据理论进行简单的程序设计和相应的验证。

关键词:喂饭机器人;机器视觉;目标检测;双目测距;

Abstract

The emergence of feeding robots is based on actual needs. In our real life, there are many elderly or patients who are inconvenient to move and need to lie in bed for a period of time or most of time. This requires professional nursing staff to carry out Nursing, while feeding robots are an alternative to feeding tools, so it is more practical and has a larger market space in the future. This thesis will study the visual positioning and recognition of feeding robots. The specific work includes: analyzing the visual system of the feeding robot through the analysis of the feeding robot vision system and the theory of machine vision. In the actual nursing process, the vision system of the feeding robot mainly needs to complete two parts of target detection and binocular ranging. The main purpose of the target detection is to obtain the position of the human mouth, and according to the position, combined with binocular ranging, the coordinates of the mouth region are obtained. Through the analysis of target detection and binocular ranging principle, the data and hardware preparation required for algorithm design are understood, and the specific structure of the algorithm is obtained. We carry out simple program design and corresponding verification according to the theory.

Key words: feeding robot; machine vision; target detection; binocular ranging.

目录

摘要 I

Abstract II

绪论 1

1.1喂饭机器人视觉系统的意义 1

1.2 国外研究现状 1

1.3 国内研究现状 2

1.4 本文主要研究内容和结构安排 4

第2章 机器视觉 5

2.1 机器视觉的发展 5

2.2 机器视觉系统构建 6

2.3机器视觉的应用 6

2.4 机器视觉在喂饭机器人上的应用 8

2.5 本章小结 10

第3章 目标检测 12

3.1 OpenCV简介 12

3.2 图像预处理 12

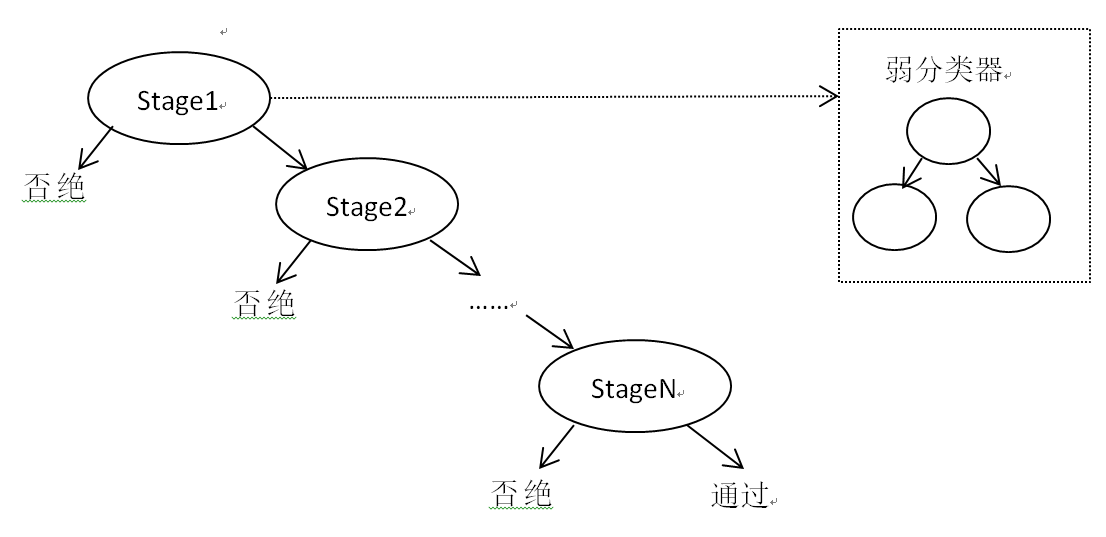

3.3 AdaBoost人脸检测算法 13

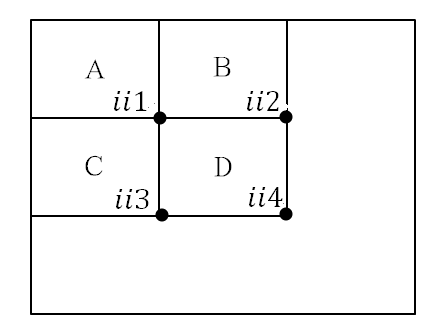

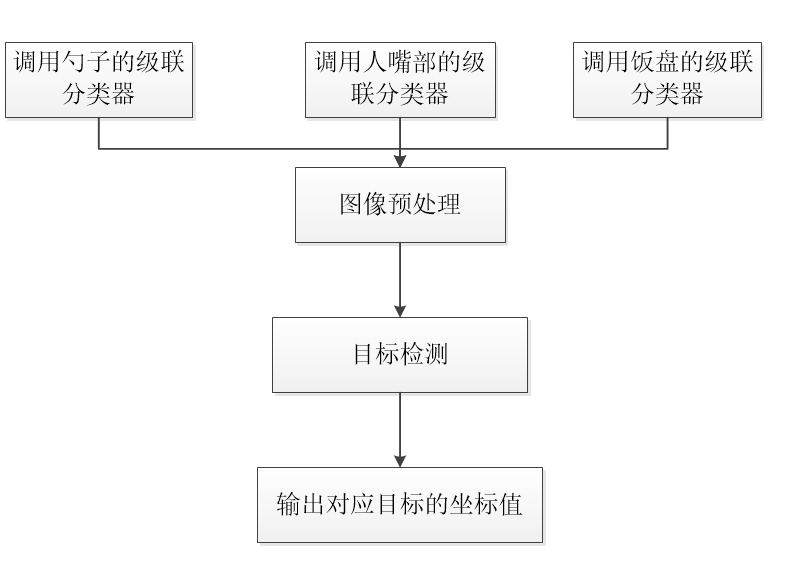

3.4 级联分类器的训练及目标检测算法设计 15

3.5本章小结 17

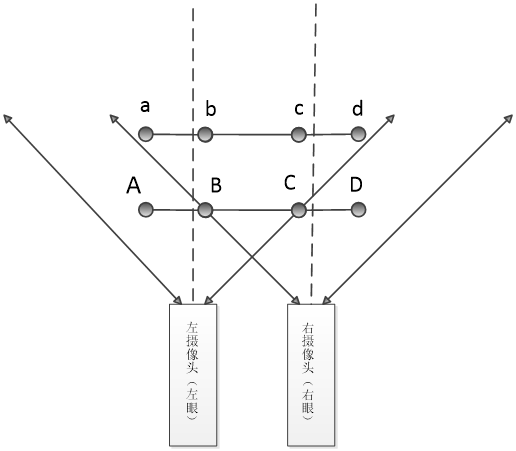

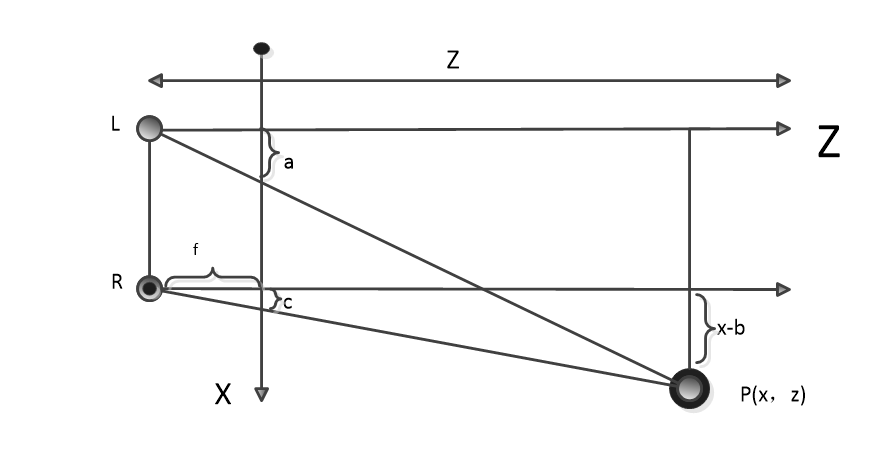

第4章 双目测距 18

4.1 双目视觉原理 18

4.2 摄像机的标定参数及获取 20

4.3本章小结 23

第5章 系统测试与结果 24

5.1 目标检测程序设计与测试 24

5.2 摄像机参数获取测试 26

5.3 双目测距程序设计及测试 28

5.4 结果分析与改进 30

5.5 本章小结 31

第6章 总结与展望 32

6.1 工作总结 32

6.2 工作展望 32

参考文献 33

致谢 34

绪论

1.1喂饭机器人视觉系统的意义

随着社会的发展与进步,服务业的格局受到了一定的影响,越来越多的人开始重视服务的质量,进而导致服务行业从业人员的压力增加,越来越少的人加入服务业,导致了部分服务行业的员工资源紧缺,养老院的员工就是这样的状况。由于工作辛苦,工作任务多,工资不够理想,很多养老院的工作人员对老人的态度很差,有的人甚至会选择离职,或者要求更高的工资,不论如何,都会变相增加养老院的负担。在这样的背景下,部分养老院需求一部分喂饭机器人代替工作人员进行喂饭的工作,这样既可以避免工作人员对待老人态度差的状况,又可以降低部分护理人员的工作负担,同时工作量的减少使得员工的需求降低,在一定程度上缓解了护理人员短缺的问题。

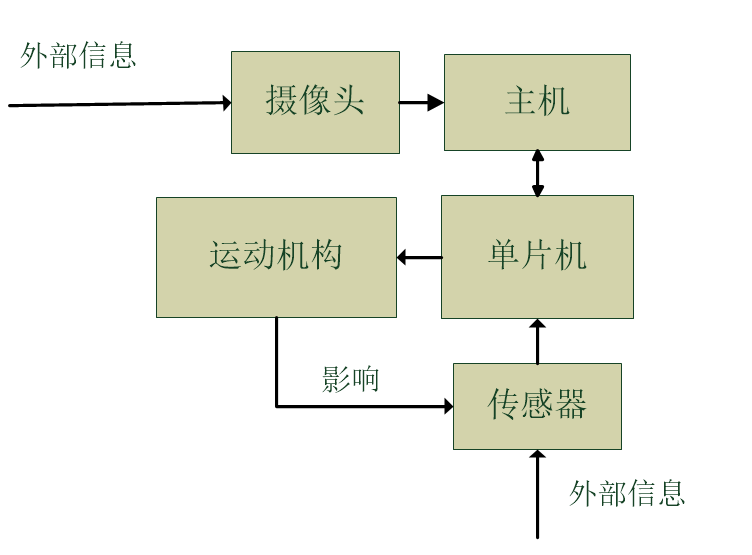

可以说喂饭机器人是根据实际需求产生的一个课题。机器人本身就是一个仿生的过程,人大部分的信息都是从眼睛中获取的,因此它获取信息的途径就是视觉系统。机器视觉是近几年来发展比较快的一个课题,它的应用也非常广泛,而人脸检测或识别又是这一系列应用中作为热门的应用。人脸检测技术的应用领域广泛,不仅仅是工业生产方面的需求,在人们日常生活中的应用也很多。我国的人脸检测识别产业的需求旺盛,由于机器有着人无法比拟的优势,包括不需要休息,没有情绪,工作效率稳定,大成本一次性支出等。社会产生的需求推动使得企业敢于投入资金,越来越多的技术应用到了实际生活中。在我国智能制造的大潮中,机器视觉无可替代。在喂饭机器人项目中,根据机器人的初步分析,喂饭机器人的视觉系统能够帮助运动机构确定运动路径的终点。还可以辅助喂饭机器人的其它感知系统,两个系统相互关联从而进行状态确认。

1.2 国外研究现状

2014年,Rahul Srivastava[1]等设计了交互式视觉距离估计机器人,利用半自动机器人装载图像处理和机器学习模块,先对机器人进行训练,然后让机器人执行相应的测距操作。

2015年,在Roland SZABOacute;[2]设计的基于机器视觉的手臂控制系统中,他们利用机器视觉系统输入信息,然后控制机器手臂进行运动。

2019年,Atieri、Ceccacci[3]等设计了一种能够检测到用户的情绪状态的系统并自适应地管理多媒体内容(例如音乐,视频剪辑等)和照明场景。情绪检测系统通过摄像头从用户的面部表情中捕捉情感,将其映射到2D空间,在该空间中多媒体内容被映射并与照明颜色匹配。他们初步测试的结果表明,所设计的系统能够以共生的方式检测用户的情绪状态并提供适当的音乐和颜色。

2019年,Domingo Mery、Ignacio Mackenney 、Esteban Villalobos[4]等设计了基于智能机的考勤系统。对于学校传统的考勤方式,老师需要在上课前进行点名,浪费了一部分课堂时间,也增加了老师的工作量。于是他们提出一种可以在传统的教室中使用的自动化学生考勤系统,其中采集图像由智能手机摄像头拍摄,这为考勤系统的推广降低了门槛。使用一种协议来评估基于学习和手工特征的十种面部识别算法,该协议考虑了在图库中使用的每个主体的面部图像的数量。经评估,在具体的实验中,最好的一个是FaceNet,一种基于深度学习功能的方法,每个受试者只有一个登记图像,达到约95%的准确率。

1.3 国内研究现状

近年来,国内在机器视觉领域取得了巨大的发展,越来越多的产品投入到了市场中,技术也在不停的发展,门槛也越来越低。

2009年,贾建成[5]设计了用于工业装配检验的机器视觉应用,他设计的应用主要是针对制造车间,其中还包括医疗注射器组装生产线上机器视觉的成功应用。其中对应的视觉检测站配有10个摄像头,集成到装配线中,能够每0.5秒检测5个注射器,总生产率为300至600份/分钟。

2011年,欧凡[6]在人脸识别的部分相关问题进行了研究,对人脸识别的光照规范化及差异补偿,通过对人脸特征的研究,发现了一种专用的特征,该特征将Gabor特征和曲线波特征两种特征进行融合,在人来检测中的表现突出。

2012年,张传宇[7]研究了主动外观模型在双摄像头人脸识别中的应用。由于使用由单个相机拍摄的图像的传统二维面部识别技术容易受到多方面因素的干扰,甚至被识别对象的情绪表达和对着摄像头的角度都会影响识别率的高低。因此他提出了一种新的三维人脸识别技术。应用双摄像头模块来提取模拟人眼来采集两个图像。应用主动外观模型来查找面部特征点。计算左眼图像和右眼图像之间的视差并用于重建3D脸部模型。从3D人脸模型中提取二十四个几何特征,然后将多类支持向量机应用于人脸识别。

2013年,江源远[8]对车辆前方行人的检测算法进行了研究,通过在汽车中加入摄像头,处理摄像头获取的数据,从摄像头中获取前方物体的位置信息,特别是行人的信息,在有行人的状况下,会输出给一个距离值给汽车,结合车辆的速度,给出减速或刹车的指令,以达到减少交通事故的目的。

2016年,樊露[9]进行了利用一个摄像头精准测距技术的研究,他仅仅利用一个手机摄像头,只改变手机尽头的焦距,对比两幅不同焦距下图片的模糊度,精确计算目标物体的距离,该方法同样适用于立体物体的距离测距,该方法对传统的单目测距技术进行了改进,提高了单目测距的精度。

2016年,李希才[10]针对双目测距的嵌入式处理器进行了研究,尝试以新型的微型高性能处理器AM5728为核心,这是首次在该平台上进行的开发,通过在该平台上的算法实践,验证该平台小体积较高性能的特征。

2017年,赵东[11]基于单目测距的技术进行车辆前行人的检测,通过该项目的研究,旨在提出一种高效且检测性能好的方案,能为汽车驾驶系统提供一种安全驾驶辅助系统,帮助汽车确认道路信息,并能自主反应突发的情况,以达到减少道路安全事故的发生。

2018年,李嫩[12]等利用机器视觉相关的库进行车辆识别的研究,该技术利用计算机视觉识别车辆信息,并将该技术应用于停车场,违停检测,电子收费等场合。

2018年,张宜方[13]阐述了机器人视觉定位技术在工业智能机器人发展中不可或缺的作用,并且尝试利用标定策略、项目分类,让定位更加迅速,准确。

2018年,张静[14]等对双目立体视觉的测量的显现进行了研究,旨在将机器视觉测距获得的数据信息转换成实际的场景,并应用3D打印技术搭建了试验台,并确定了结构参数。

2018年,杜鹃[15]进对人脸识别相关的算法进行了研究,她提出了先检测和识别的方案,设计了一种基于OpenCV的即时识别系统,其次提供了人脸注册功能,注册过的人脸信息能够准确地识别出来,这使得该系统在考勤系统能够得到应用,使用价值较高,她提出的先检测后识别的方案在一定程度上也提高了人脸识别的速率

2018年,陈莉[16]进行了基于机器视觉的双摄像头测距系统的研究与实现,她根据双目测距的原理,利用两个摄像头搭建了外部的图像采集环境。利用张正友的标定方法对摄像头的相关参数进行标定,对标定的参数又结合Bouguet畸变矫正算法进行校正。在实际的测距过程中,利用灰度图像变换,然后进行图像处理,以提高图像立体匹配的准确度。

2019年,中国地质大学自动化学院的吴敏、万欢苏[17]等人提出了权重自适应卷积神经网络(WACNN)来提取用于识别面部表情的判别表达表示。它旨在充分利用卷积神经网络(CNN)的潜在性能,通过具有最优初始种群的混合遗传算法(HGA)来避免局部最优和加速收敛,从而实现深度和全局情感理解。人机交互。此外,引入新颖性搜索的思想来解决HGA中的欺骗问题,其可以花费搜索空间来帮助遗传算法跳出局部最优并优化大规模参数。其设计的轮式机器人最后能识别情绪的基本表达。

2019年,张世清、仙张潘、崔玉丽[18]等通过混合深度学习学习情感视频特征,并进行面部表情识别。所提出的方法首先采用两个单独的深度卷积神经网络(CNN),包括处理静态面部图像的空间CNN网络和处理光学流图像的时间CNN网络,以分别学习分割视频片段上的高级空间和时间特征。这两个CNN在来自预训练的CNN模型的目标视频面部表情数据集上进行微调。然后,获得的分段级空间和时间特征被集成在使用深度信任网络(DBN)模型构建的深度融合网络中。这种深度融合网络用于共同学习有区别的时空特征。最后,对视频序列中的学习的DBN段级特征执行平均池,以产生固定长度的全局视频特征表示。

1.4 本文主要研究内容和结构安排

本文将对喂饭机器人视觉定位方法和识别方法进行研究,本文将采用双目测距进行视觉定位,识别方法是基于OpenCV的目标检测,通过这两种方法的结合设计喂饭机器人的视觉系统。因此本文分为五章,主要介绍以下内容:

第一章为绪论,主要介绍喂饭机器人的研究意义,介绍视觉系统在喂饭机器人整个系统中的地位与作用,并对国内外的研究现状进行了解,并对涉及到测距和检测识别相关的技术进行总结,最后介绍本文的研究内容和结构安排。

第二章为喂饭机器人的视觉系统分析,分析了喂饭机器人视觉系统的主要任务,并依据任务进行了喂饭机器人的机构分析,验证了分析的正确性。

第三章介绍了机器视觉的发展现状,并对一个基本的机器视觉系统的构建的模块进行了分析,并对机器视觉的应用场景进行了介绍,最后通过对机器视觉系统的了解,构建喂饭机器人的视觉系统。

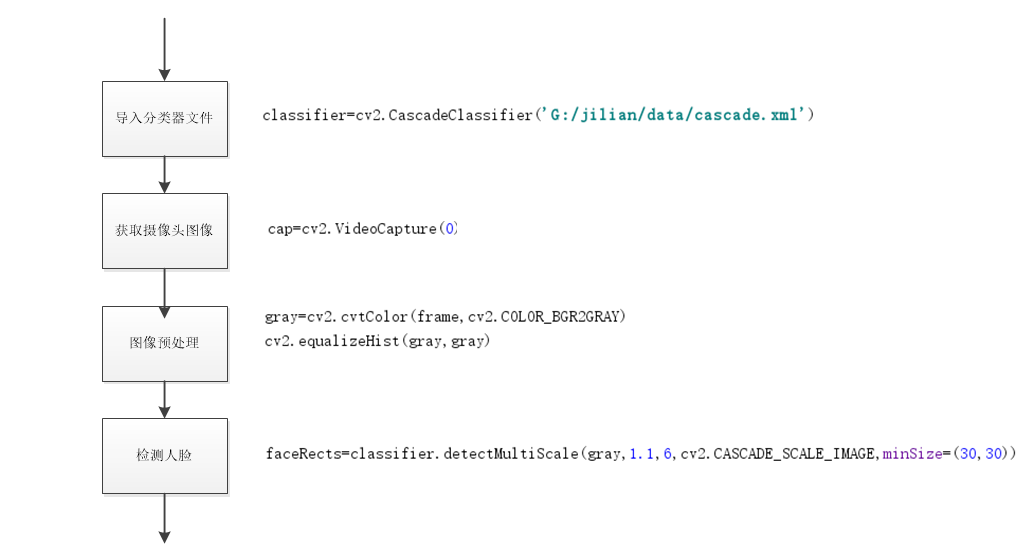

第四章先介绍了OpenCV,基于该机器视觉库进行目标检测的研究,在目标检测的过程中涉及到图像的预处理,还有经过训练的级联分类器以及相关的训练方法,并对人嘴部的检测方法进行了设计。

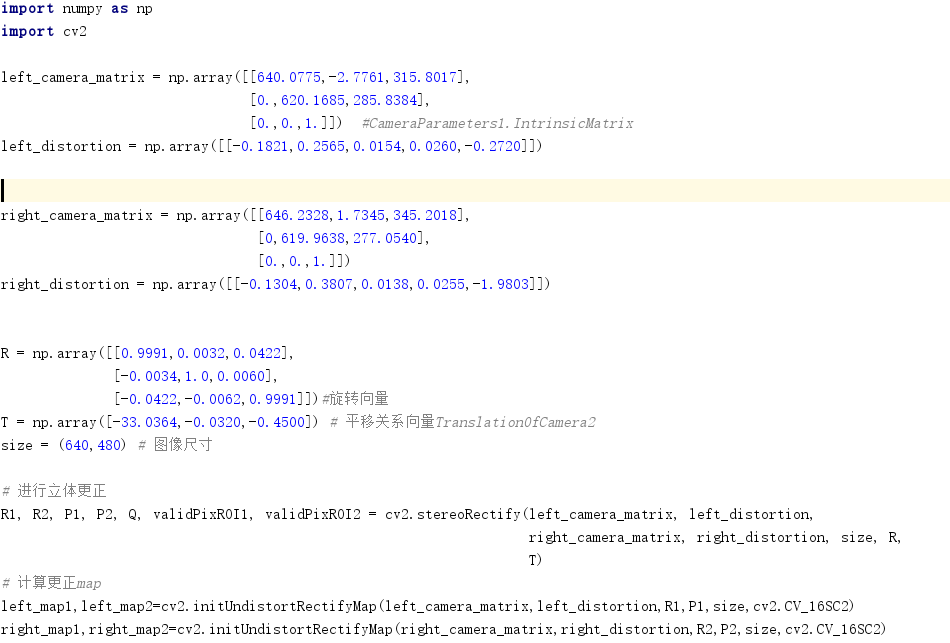

第五章首先介绍了双目测距的原理,并对其中涉及到的摄像头标定参数方法进行了介绍,同时也介绍了双目测距中涉及到的立体校正,并对校正的原理和校正所需要的参数进行了介绍。

第六章为系统的测试过程,包括相机的参数标定的具体实现,调用训练好的级联分类器进行人嘴部检测验证,利用Python编写相关的程序,依据双目测距的流程,设计双目测距的程序,进行相关的验证。

第七章为总结与展望,对本论文的方案进行总结,提出相关的展望。

第2章 机器视觉

随着时代的发展与科技的进步,人类在信号处理、电子技术、计算机等方面取得巨大的发展,这也使得机器视觉得到了迅速的发展,并且也大量应用于我们的生产生活实践,例如当前被宣传的最多的天眼系统,工业4.0等等。新闻中在张学友的演唱会经常会有在逃犯人被抓捕的消息,被发现的如此准迅速,它的背后就是强大的天眼系统,云端能够对前端传来的实时图像数据进行处理,对视频图像中的人面部进行识别,然后依据人物面部特征来确定人的身份,而身份信息又包括人物的档案记录。如果人的档案记录中有犯罪记录显示,那么该人物就会被提示,引起警察的注意。

2.1 机器视觉的发展

人类通过眼睛来获取视觉信息,再经过神经传输到大脑,大脑进一步处理和理解视觉信息,最终加上个人的理解,形成完整的视觉信息,这种信息不一定完全准确,因为它受到个人理解的影响,这种理解可能与阅历,知识,想象力等方面有关。

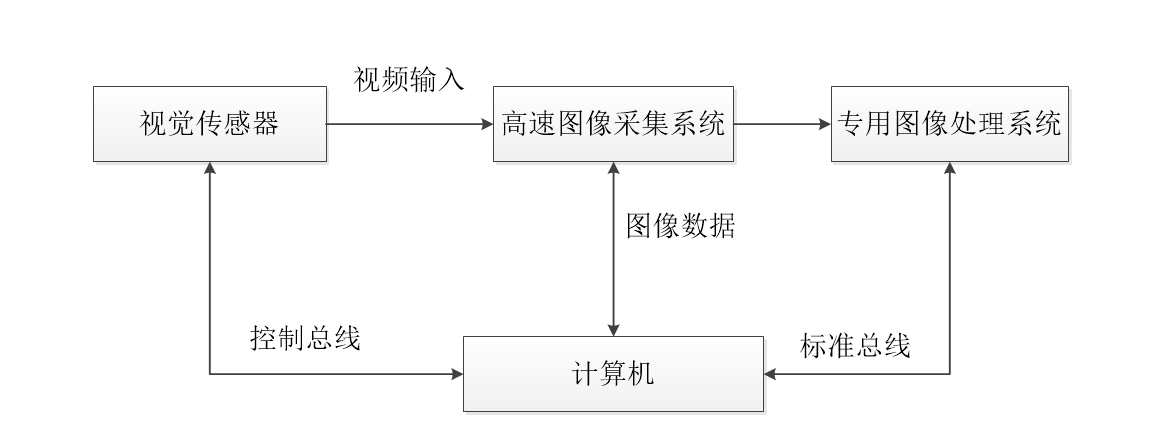

随着与机器视觉相关的技术的飞速发展,不仅使人类进入了信息的时代,而且为机器视觉的发展提供了良好的客观条件。机器视觉就是利用摄像头采集的与目标相关的图像,并将这些图像转换成数字信号,用计算机实现对视觉信息的处理,然后得到我们想要信息的过程。机器视觉发展的如此迅速,以至于到现在它的许多功能已经超过了人眼,这得益于机器视觉背后计算机强大的处理器。例如天眼系统就是这样的一种系统,对于庞大的信息数据,我们人类的大脑只能记住其中一部分渺小的数据,而且对于数据调用也受到数据存储时间的影响,而计算机能够储存和计算大量的数据,并且数据调用不受存储时间的影响。机器视觉是建立在计算机视觉理论基础上以完成工程任务的技术,在我们的实际生活中,它主要实现目标检测、对象识别、测距、获取目标形状等任务。

20世纪50年代,计算机视觉是从模式识别开始的,模式识别的任务主要是二维图像分析,识别和理解的工作。到60年代,Roberts开始进行三维机器视觉的研究,但是这时的三维结构只能由简单的点线面的组合表示,因为环境限制在所谓的“积木世界”,即环境中的物体都是由多面体组成的,计算机再从中提取出相应的三维结构。直到1977年,英国的Marr教授才提出不同于“积木世界”的分析方法的计算机视觉理论,它就是计算机视觉研究领域十分重要的Marr视觉理论。Marr的视觉计算理论是首次提出的阐述视觉机理的理论,它首次从信息处理的角度结合了图像处理、神经学等方面的知识,对人类视觉和计算机视觉都产生了深远的推动影响[19]。

机器视觉体系被Marr的理论体系划分为三层,即计算理论层次,表达与算法层次和硬件实现层次。计算理论的含义是告诉我们什么是计算目的以及计算方式的原因,表达与算法层次阐述了理论的实现,硬件实现则是要在物理上实现表达与算法。

以上是毕业论文大纲或资料介绍,该课题完整毕业论文、开题报告、任务书、程序设计、图纸设计等资料请添加微信获取,微信号:bysjorg。

相关图片展示:

课题毕业论文、开题报告、任务书、外文翻译、程序设计、图纸设计等资料可联系客服协助查找。